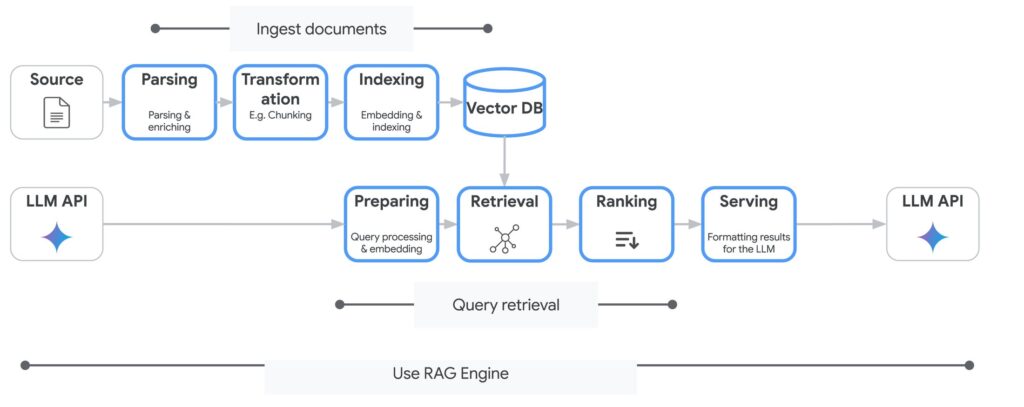

Google Cloud 推出 Vertex AI RAG Engine,這是一項完全托管的服務,幫助用戶構建和部署檢索增強生成(RAG)。該引擎靈活適配模型、向量數據庫和數據源,易於集成現有基礎設施,並可隨需求增長進行擴展。用戶可設置多個配置、混合組件以滿足不同需求。引擎優化了大數據處理和低延遲響應,提供高效搜索和準確的 LLM 輸出,並簡化多源數據管理,提升整體性能與效率。

文章重點

【介紹】

- 【定義與目標】Vertex AI RAG Engine 是一個完全托管的服務,幫助用戶利用自己的數據和方法構建和部署檢索增強生成(RAG)實現。

- 【靈活選擇】用戶可根據用例選擇模型、向量數據庫和數據來源,讓 RAG Engine 無縫整合至現有基礎設施中。

【功能】

- 適應性

- 用戶可選擇適合其用例的模型、向量數據庫和數據來源,確保靈活整合到現有基礎設施中。

- 可擴展性

- 系統隨需求變化而增長,支持添加新數據來源或調整檢索參數,滿足不斷變化的需求。

- 評估

- 用戶可設置多個 RAG Engine 進行對比,找到最適合其需求的配置。

【能力】

- DIY RAG

- 通過混合組件自定義解決方案,適合低到中等複雜度的用例。

- 搜索功能

- 借助 Vertex AI Search 提供高質量檢索結果,並減少維護成本。

- 連接器

- 支持快速集成數據來源,如 Cloud Storage、Google Drive 等,提供更廣泛的數據接入支持。

- 性能和可擴展性

- 優化處理大數據量並實現低延遲,提升響應速度。

- 數據管理

- 簡化多來源數據輸入流程,增強數據管理效率。

- LLM 輸出質量

- 增強檢索能力,從大型語言模型(LLMs)獲取更準確和豐富的信息。

【自定義】

- 解析

- 可調整文檔摘要的塊大小與策略,精確適配特定需求。

- 檢索

- 支持與 Pinecone、Weaviate 等向量存儲解決方案兼容,靈活處理多樣化檢索場景。

- 生成

- 通過 Vertex AI Model Garden 訪問各種 LLMs,定制化輸出生成。

【用例】

- 【上下文相關互動】

- 與 Gemini API 集成,構建具備上下文相關性的對話系統,提升用戶交互體驗。

【入門指南】

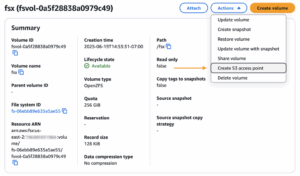

- 【訪問入口】通過 Vertex AI Studio 啟用 RAG Engine。

- 【資源支持】鼓勵探索快速入門文檔及 GitHub 存儲庫以獲取詳細指導。